Mestersége: Intelligencia 3.

Álmodik-e MI villanybirkákkal?

A jogi szakirodalom nagyjából az alábbiakat várja el MI-től ahhoz, hogy önálló személyiségként tekinthessünk rá:

– rendelkezzen a kommunikáció képességével,

– rendelkezzen ismeretekkel önmagáról,

– legyen képes érzékelni környezetét, tudjon tanulni belőle és a megszerzett ismereteket tudja hasznosítani,

– képes legyen hatást gyakorolni a környezetére,

– célorientált működés jellemezze, és

– kudarc esetén legyen képes alternatív megoldásokat alkalmazni.

Mint látjuk, ez máris több, mint amit egy ittas állapotban lévő fajtársunktól elvárhatunk.

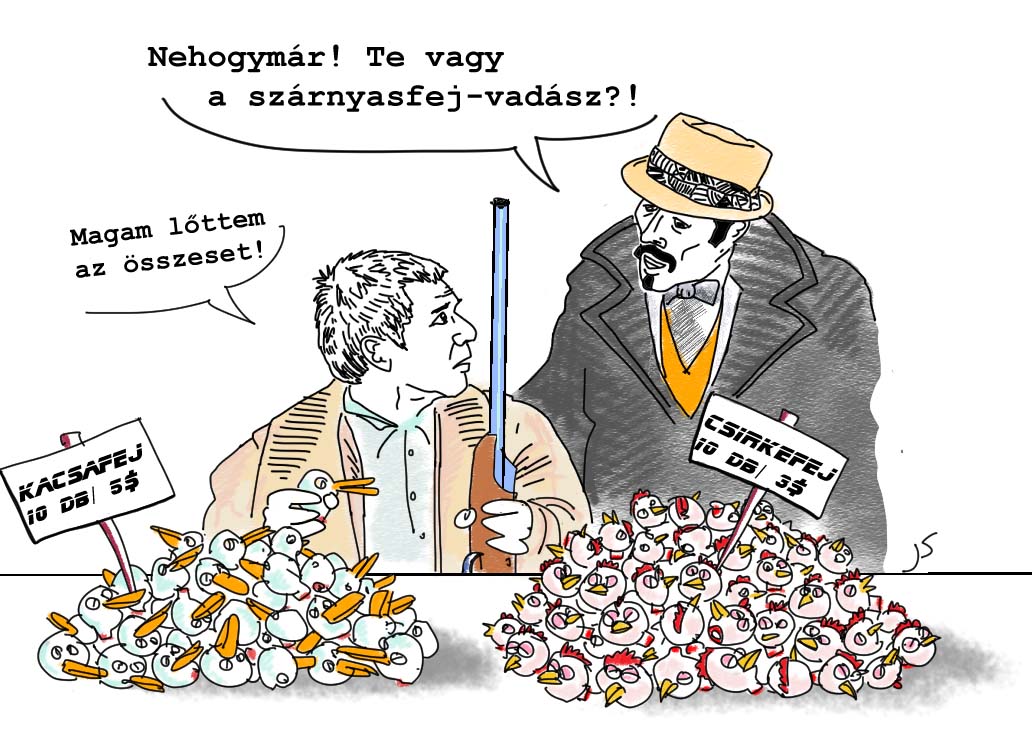

Álmodnak-e az androidok elektromos bárányokkal? – tette föl a kérdést Philip K. Dick 1968-ban megjelent sci-fi regényében, amely regény alapján forgatták később a Szárnyas fejvadászt (1982., rendezte: Ridley Scott). Ha a mesterséges intelligenciával ellátott bárányok robotok rendelkeznek a fenti tulajdonságokkal, akkor a Szárnyas ügyésznek fejvadásznak nagyon hamar el kell gondolkodnia azon, ki a felelős az MI által esetleg elkövetett bűncselekményekért.

Igazából az önfélvezető gépjárművek programozásánál már el is kellett gondolkozni ezen. Vegyük az alábbi esetet: egy szabályosan közlekedő gépjármű elé féktávolságon belül kifut egy kisgyerek a labdája után, a gépjárműben három utas ül, a szemközti sávban egy gépjármű halad két utassal, a járdán idős emberek csoportja sétál.

A gépjármű vezetője ösztönösen dönt: elüti a gyermeket, vagy elkapja a kormányt és frontálisan ütközik a szemközti autóval, vagy fölfut a járdára egyenesen bele az idősek csoportjába.

Ezzel szemben MI a másodperc tört része alatt nemcsak azt tudja fölmérni, hogy képtelen féktávon belül megállítani az autót, hanem azt is, hogy

- vagy egy kisgyereket üt el,

- vagy a frontális ütközés miatt meghal három utas és a szemközti gépjármű két utasa (egyszerű művelettel: 3+2=5),

- vagy a járdán elüthet 3-4 idős embert (valószínűségszámítás).

Az emberi ösztön vezérelte véletlen helyett MI-nek valamilyen elv szerint kell meghoznia a döntést. Ez az elv azonban sokféle lehet az adott programtól függően. Például:

- Egy ember halála kisebb rossz, mint több ember halála (tehát üsse el a gyereket.)

- A biztos halál rosszabb, mint a valószínű halál (hátha az idősek el tudnak ugrani.)

- A vétlen helyett a szabályszegő haljon meg. (De vajon felróhatjuk-e egy kisgyereknek a szabályszegést.)

- Az idősek többet éltek már, mint a fiatalabbak (megint az idősekre jön ki a matek).

- Az halljon meg, akinek érdekében a veszélyes üzem (lásd: gépjármű) működik (vagyis az autóban ülő személy/személyek).

- Esetleg MI sorsoljon (lásd véletlenszám generátort a programban).

Mi legyen akkor, ha MI bűnözésre adja a fejét bitjeit? Gabriell Hallevy tanulmánya alapján a robotok által megvalósított bűncselekmények miatti felelősséget illetően három modellt különböztethetünk meg:

- Büntessék az embert, aki a büntetendő cselekmény megvalósítására utasítást adott: a programozót vagy a felhasználót. (Ez a modell úgy tekintene az esetre, mint amikor a vétőképes egy vétőképtelent használ fel, például egy felnőtt egy kisgyereket bír rá a lopásra.)

- Ha MI-nek senki nem adott parancsot bűncselekményre, hanem a tanulási folyamat révén jutott saját elhatározásra, akkor a klasszikus büntetőjogi tan szerint a programozó legfeljebb gondatlan lehet, de az is csak akkor, ha előre látta cselekményének lehetséges következményeit, de könnyelműen bízott azok elmaradásában, vagy cselekménye lehetséges következményeit azért nem látta előre, mert a tőle elvárható figyelmet vagy körültekintést elmulasztotta. Ekkor az ember gondatlan bűncselekményért felel.

- A harmadik modell a mesterséges intelligencia közvetlen büntetőjogi felelősségét veti föl. Amennyiben a robot az ember büntetőjogi felelősségének megállapításához szükséges ténybeli és mentális feltételeket teljesíti, úgy semmi akadálya MI büntetőjogi felelőssége megállapításának.

Ha MI büntethető, akkor kérdés, milyen büntetés szabható ki vele szemben a társadalom védelme érdekében, vagyis annak megelőzése érdekében, hogy akár Ő, akár más program bűncselekményt kövessen el? (Lásd: büntetés célja: Btk. 79. §.)

Halálbüntetés vírus által? Életfogytig tartó áramtalanítás (Btk. 41. §)? Határozott ideig tartó konnektorból való kihúzás? Felfüggesztett működés tárhelycsökkentés által? Pénzbüntetés (Btk. 50. §)? Bitcoint is elfogadunk? Járművezetéstől eltiltás önvezető gépjárműveknél (Btk. 55. §)? Foglalkozástól eltiltás (például automatikus tőzsdei kereskedés esetén – Btk. 52. §)? MI kitiltása MO-ról vagy az internetről (Btk. 57. §)?

Elégedjünk meg büntetőjogi intézkedéssel; például kényszergyógyítással programozók által (Btk. 78. §) vagy elektronikus adat végleges hozzáférhetetlenné tételével (Btk. 77. §)?

Úgy tűnik, több a kérdés, mint a válasz. Vicces lenne megkérdezni MI-től, milyen büntetést látna kiszabhatónak saját magával szemben, de ma még be kell szállnom egy liftbe, majd föl kell szállnom a metróra, és a számítógépet sem kapcsoltam ki még, így inkább nem viccelek vele.

Jelen írás nem jött volna létre, ha Ott István tanulmányát nem lopom el használom fel.

(folytatjuk)